Wenn’s nur die Gesichtserkennung wäre. Über Kameras, Twitter und Scheren — Issue #42

Merkt Ihr es? Der Winter ist so langsam da. Zumindest in Berlin — andernorts hat es ja schon geschneit; hier gehen die Temperaturen nun…

Merkt Ihr es? Der Winter ist so langsam da. Zumindest in Berlin — andernorts hat es ja schon geschneit; hier gehen die Temperaturen nun auch gen Null Grad. Mir ist’s so ja lieber, als die stehende Hitze im Sommer. Und auch besser als Schneematsch und grau und dunkel. Mit dem Wetter kann man es ja nie allen recht machen, aber dass wir bisher den ganzen Januar eher frühlingshaftes Wetter hatten, das sorgt mich schon.

Diese Woche war recht turbulent. Ich habe Anwält:innen in einem Workshop versucht LinkedIn schmackhaft zu machen und die Vorzüge von Social Media erklärt (im Gedächtnis bleiben, immer aktuelle Kontaktdaten, Ideen für Gesprächseinstiege beim Aufeinandertreffen, neue Leute kennenlernen, spannende Artikel, …), ich habe mit Alex Sängerlaub und Charlotte Carnehl bei der Landeszentrale für Politische Bildung über Desinformation diskutiert (auf Einladung der Europäischen Akademie und der Friedrich-Naumann-Stiftung) und das war wieder ganz großartig. Folgt Alex unbedingt, wenn Euch das Thema “Stärkung der digitalen Öffentlichkeit” interessiert! In diesem Projekt ist auch das Papier “Regulatorische Reaktionen auf Desinformation” von seinem Kollegen Dr. Julian Jaursch erschienen, dass der Moderator mitbrachte und ich nochmal betonte, dass es sehr lesenswert ist! Also lest es! Dann gab es noch ein Zitat von mir in der FAZ Woche (yay!) und ein lang geplantes Dinner bei mir (aber kein Hackhähnchen!). Und ich empfehle es nicht nur gerne auf Podien sondern auch hier: Ladet Euch Menschen ein, die einander unbedingt mal kennenlernen müssen. Besorgt Wein und kocht was Leckeres. Es gibt nichts Großartigeres, als Menschen zu vernetzen und eine persönliche Atmosphäre zu haben. Dazu hilft auch kein Separee im Restaurant! Falls Ihr noch Vorsätze fürs Jahr braucht — das wäre einer, der leicht zu schaffen ist 😉 Ich habe einen von meinen heute Abend hoffentlich geschafft: Alle Activity-Ringe der Apple Watch eine Woche lang jeden Tag schließen. Gamification und Sport werden mich dieses Jahr noch ganz schön in die Bredouille bringen, wartet nur ab 😬🙃🏋🏽♀️

Habt einen entspannten Sonntag

Ann Cathrin

P.S.: Ich würde mich freuen, wenn Du mich und meine Arbeit mit monatlich 3,50, 5 oder 10 Euro über Steady unterstützen würdest.

WHAT TO KNOW

Die letzte Woche habe ich hier bereits über den damals ganz frischen Skandal der Firma Clearview AI geschrieben. Das kam — passenderweise — zeitgleich zu den Forderungen des Bundesinnenministeriums, an Flughäfen und Bahnhöfen Überwachungskameras mit Gesichtserkennung zu installieren. Von der Idee ist das Ministerium zum Glück abgekommen. Fragt sich nur wie lange. Die Grünen und auch die neue SPD-Vorsitzende Saskia Esken fordern ein Verbot von Gesichtserkennung im öffentlichen Raum und schließen sich damit auch Forderungen aus der Europäischen Kommission an. Gut so! Über die Probleme habe ich ja mehrfach in den vergangenen Ausgaben berichtet (z. B. hier )

Wie letzte Woche bereits geschrieben, Clearview hat auf jeden Fall gegen die Nutzungsbedingungen von Facebook und Twitter verstoßen. Twitter hat das Unternehmen nun aufgefordert, alle unrechtmäßig gescrapten Bilder aus den Datenbanken zu löschen. Gut, dass Twitter das fordert. Fraglich, wie Twitter oder irgendwer anders das überprüfen kann. Facebook hat sich meines Wissens nach noch nicht geäußert und hier ist ja das kritische — wie ich letzte Woche schrieb — dass Peter Thiel Investor bei Clearview ist und im Board von Facebook sitzt. Wir werden sehen. Ob das Unternehmen auch gegen die europäische Datenschutzverordnung verstoßen hat, da sind die Jurist:innen sich uneins. Simon Hurtz hat für die Süddeutsche Zeitung ein paar Fragen zu dem Skandal beantwortet und unter anderem diese Frage beleuchtet. Prof. Alexander Roßnagel sagt, es lege ein Verstoß vor, der Richter Dr. Malte Engeler sagt, es könne vom Recht gedeckt sein, da das Unternehmen wie eine Suchmaschine gehandelt habe. Spannend wird, wie es weiter geht und ob von europäischer Seite ermittelt wird.

Buzzfeed hat sich den Skandal ebenfalls angesehen und heraus gefunden, dass unter anderem bei der Bewerbung des Produkts gelogen wurde: In New York wurde ein gesuchter Terrorist mit den üblichen Ermittlungsmethoden gefasst und nicht mit Hilfe von Clearview.

Clearview: Warum Gesichtserkennung so gefährlich ist — Digital — SZ.de — www.sueddeutsche.de

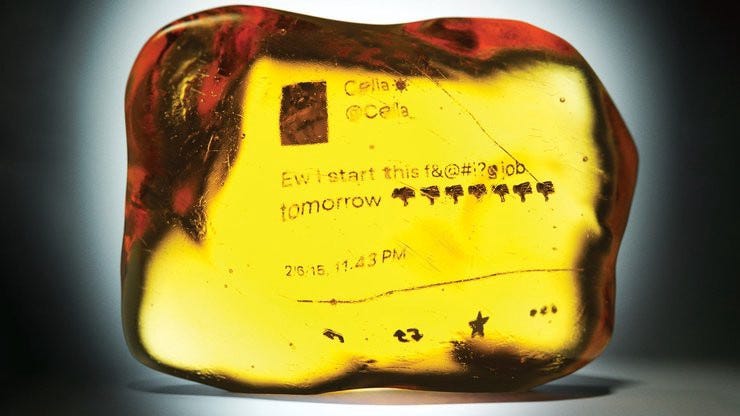

Wisst Ihr noch, als gewarnt wurde, dass man Jobs nicht bekommt, weil man auf Facebook Fotos im besoffenen Zustand von einer Party hochgeladen hatte oder von anderen markiert wurde und man deswegen keinen Job mehr bekommen kann, wenn man Pech hat? Zeiten waren das damals. Für meine Generation ist das Problem doch etwas gravierender, für alle Folgenden richtig schlimm. Wer Eltern hat, die schon exzessiv Babyfotos von einem ins Netz stellten, dessen Leben lässt sich fast lückenlos zurück verfolgen. Aber auch von dem, was man selber ins Netz stellt, sind Unmengen an Informationen über einen verfügbar. Auch darüber schrieb ich erst vor Kurzem. Was ist aber nebst dummen Tweets, die einem den Job kosten noch problematischer? Wenn man nicht weiß, was andere — zum Beispiel die Schule — mit den Daten macht.

Digital school security companies typically delete student data after 30 days, but schools and school districts are free to keep it for much longer. The data is also frequently shared with law enforcement when potential threats are identified. It is unclear what data is being collected by security or learning software, and for how long it is kept. As three US senators wrote in a recent letter to more than 50 educational technology companies and data brokers, “Students have little control over how their data is being used …[they] are often unaware of the amount and type of data being collected about them and who may have access to it.” After all, without any clear checks and balances, one’s bad grades or an intemperate message from middle school could be sold to a job recruitment agency years later.

Den wichtigsten Aspekt in diesem Text, der einem nochmal vor Augen führt, wie sehr das eigene Leben digital einsehbar ist, ist dieser hier: Kinder, Jugendliche müssen Fehler machen dürfen und die müssen ihnen auch verzeihen werden. Das ist der Kern des Heranwachsens und des Ausbildens bzw. Erlernens von Moral und dem “richtigen” Handeln. Wenn aber alles gespeichert bleibt, wie immer wieder die Vergangenheit ran ziehen um ein Individuum heute zu beurteilen, kann das schwerwiegende Folgen haben:

His argument may be a poor excuse for his actions, but it raises a question we can’t afford to ignore: Should one’s past define one’s future? The risk is that young people who hold extreme views as teenagers may feel there’s no use changing their minds if a negative perception of them sticks regardless. Simply put, in the future, geeky kids remain geeky, dumb jocks remain dumb, and bigots remain bigots. Identities and political perspectives will be hardened in place, not because people are resistant to change but because they won’t be allowed to shed their past. In a world where partisan politics and extremism continue to gain ground, this may be the most dangerous consequence of coming of age in an era when one has nothing left to hide.

Why an internet that never forgets is especially bad for young people — MIT Technology Review — www.technologyreview.com

Als Conclusio aus Artikel eins und zwei folgt dieser hier: Es ist super, wenn sich Widerstand gegen Gesichtserkennung regt. Nach meinem Geschmack könnte der deutlich(!) größer sein und irgendwo bleibt — wie schon gesagt — das ungute Gefühl, dass vor allem der Clearview-Skandal dazu beitrug, dass man hier gemerkt hat, dass Gesichtserkennung im öffentlichen Raum keine gute Idee ist. Aber: Sich beim Thema bzw. der Sorge von Überwachung nur auf Gesichtserkennung zu fokussieren, greift zu kurz:

We need to have a serious conversation about all the technologies of identification, correlation and discrimination, and decide how much we as a society want to be spied on by governments and corporations — and what sorts of influence we want them to have over our lives.

Überwachung funktioniert längt nicht mehr so wie wir es schon lange kennen: Mit Kameras, jetzt halt mit Gesichtserkennung. Eben irgendwas, das wir uns vorstellen können, bzw. eh schon gewohnt sind. Überwachung und die zugehörige Gesetzgebung funktioniert viel subtiler und macht sich vor allem erst dann bemerkbar, wenn es fast schon zu spät ist. Hier erinnere ich nochmal an die Situation in Hongkong.

Opinion | We’re Banning Facial Recognition. We’re Missing the Point. — The New York Times — www.nytimes.com

Der Technologie, Plattformen (alleinig, mindestens implizit) die Schuld an Hass und Verrohung geben, ist sehr paternalistisch. Es verlagert unsere Verantwortung für unser Verhalten weg von uns und macht uns zu bloßen verführten Wesen, die nichts für ihr Tun können. Dieser, wie ich finde ziemlich kluger Kommentar, weißt darauf hin, dass auf Twitter eben nicht nur Schlechtes ist, sondern auch sehr, sehr viel Gutes. Menschen reden über Poesie und werden darauf aufmerksam, sie helfen und unterstützen einander — obwohl sie sich gar nicht kennen. Sie informieren, philosophieren, sind witzig und diskutieren. Twitter ist eben das, was man daraus macht. Und es ist auch eine Sache der Medien, welche Tweets und Diskussionen wir in die klassischen Kanäle holen und damit hochjazzen.

Hinter der These «Twitter verroht uns!» kann man sich bequem verstecken. Damit gibt man die Verantwortung an eine technologisch-mediale Struktur ab und ist selbst aus dem Schneider. Nichts könnte einer liberalen Mentalität fernerliegen. Eine solche müsste die Medien eher als plastische Gebilde oder als Sparringspartner betrachten. Mit Sparringspartnern trainieren wir, um an ihnen zu wachsen und irgendwann besser zu sein als sie. Allen deterministischen Diagnosen der frühen Medientheorie à la «the medium is the massage» (Marshall McLuhan) zum Trotz: Wir sind es, die die Medien nutzen und nachfrageseitig ihre Evolution beeinflussen. Und dabei treffen wir immer eine Wahl.

Das alles heißt natürlich nicht — und darauf weißt der Autor auch am Ende hin — dass ein keiner Regulierung bedarf. Nicht alles lässt sich mit zivilgesellschaftlichem Engagement lösen:

Was wir hingegen nicht individuell oder zivilgesellschaftlich beeinflussen können, etwa die Privilegierung von Hass und Hetze durch algorithmische Weichenstellungen oder das willkürliche Sperren von Accounts durch die Twitter-Obrigkeit, das muss die Politik regulieren. Liberalismus bedeutet nicht Politik- oder Staatsfeindlichkeit. Sondern das Eingreifen des Staates und der Politik dort, aber nur dort, wo Individuen und Zivilgesellschaft an ihre Grenzen stossen.

Twitter ist nicht schuld. Wenn schon, sind wir selbst das Problem — und die Trolle — www.nzz.ch

„Sollte man Sie tot in Ihrer Badewanne finden, haben wir zumindest einen Ermittlungshinweis.“ — so wurde mit der Bremer Streamerin Powny auf einer Polizeiwache umgegangen, als sie Mord- und Vergewaltigungsdrohungen gegen sie auf der Streamingplattform Twitch anzeigen wollte. Den gesamten Gesprächsverlauf hat sie auf Twitter geschildert. Ich höre schon seit Jahren, gerade von Aktivist:innen, dass die Polizei Drohungen gegen sie im Internet häufig nicht ernst nehmen und dazu raten, doch einfach den eigenen Account zu löschen und stattdessen irgendwas “Richtiges” zu machen. Während immer mehr Befugnisse und neue Gesetze seitens der Politik gefordert werden, schaffen es aber unsere Polizei und Justiz die bestehenden Möglichkeiten auszunutzen. Sei es durch mangelndes Personal oder mangelnde Fort- und Weiterbildung. Opfer von Hass und Drohungen werden sich vornehmlich dann sicher(er) fühlen, wenn Ermittlungsbehörden das, was ihnen widerfährt, ernst nehmen. Wenn sie vor Ort spüren, dass die Polizei sich kümmert. Nicht, wenn mit weiteren Befugnissen Bürgerrechte von allen ausgehöhlt werden und weitere Überwachungsmaßnahmen gegen alle — und eben nicht nur gegen Täter:innen — eingeführt werden.

Schuldzuweisung statt Opferschutz — netzpolitik.org — netzpolitik.org

Könnte auch in die Leseliste, aber dafür ist es zu großartig: Schlaue Leute mit vermutlich zu viel Zeit haben sich an die Arbeit gemacht und geprüft, welche Emoji-Schere von welchem Anbieter eigentlich funktionsfähig wäre. Die von Apple, wie Ihr hier auf dem Bild seht ist es nicht. Der Text verrät Euch welche! Spoiler: Nur eine schließt komplett 😉🤯😱✂️

Which emoji scissors close — wh0.github.io

+++ Anzeige +++

Am 28. Mai 2020 findet in Luxemburg die Europäische Datenschutz Konferenz GDPR+2statt. Sie richtet sich sowohl an C-Level-Manager, Datenschutzbeauftragte, IT-Sicherheitsexpertinnen, Fachanwälte und viele mehr! Mehr Infos und Tickets gibt es unter:https://www.gdpr-conference.eu/

WHAT TO HEAR

Episode 13 | Prof. Dr. Dirk Heckmann — über redliche und unredliche Geschäftsmodelle — Visionäre der Gesundheit — visionaere-gesundheit.de

Wir müssen zwischen redlichen und unredlichen Geschäftsmodellen unterscheiden und anhand dieser Linie Regulierung machen. Das habe ich von Prof. Dirk Heckmann. In diesem Interview spricht er genau darüber.

WHAT TO WATCH

Ich bin ja eigentlich niemand, der Serien empfiehlt, weil ich kaum welche gucke, nie die, die wirklich ALLE gesehen haben und wenn, dann gucke ich meine Serie wieder und wieder. Da The Good Wife, mein absoluter Favorit nicht mehr bei Netflix ist und ich nichts mehr zum gucken hatte (ich habe alle 7 Staffeln viermal gesehen 😬) musste ich mir was neues suchen und empfehle Euch dringend Sex Education! Letztes Wochenende habe ich die zweite Staffel komplett durch geguckt und warte jetzt sehnlichst auf die dritte! Warum ich sie mag? Witzig, deep und keine Klischees!

WHERE TO GO

Körber Debate: Soll Deutschland Cyberangriffe durchführen dürfen? — Körber-Stiftung — www.koerber-stiftung.de

Hamburg, I’m coming for ya! Am 19.2.2020 diskutiere ich mit Martin Schallbruch darüber, ob Deutschland Cyberangriffe durchführen sollen dürfen. Anmelden kann man sich ab dem 5.2.2020 (kostenlos), vormerken schon jetzt!

Fachkongress Digitale Gesellschaft 2020 | Initiative D21

Save the Date! Am 25. Februar 2020 stellt die Initiative D21 u.a. ihren neuen D21-Digital-Index 2019 / 2020 vor!

WHAT TO READ

Vom Autovermieter Buchbinder standen Millionen an Datensätzen von Kund:innen frei im Netz. Neben Bußgeldern wegen Verstößen gegen den Datenschutz, wird das Unternehmen wohl auch mit Schadensersatzansprüchen zu tun haben.

Die USA blockierten die Server der iranischen Nachrichtenagentur Fars — ein No Go und spielt Ländern wie Russland und China in die Hände, die unabhängig vom globalen Netz sein wollen oder es bereits sind.

Die Medien-Krise bedroht Demokratie, sagt der Wikipedia-Gründer Jimmy Wales.

Facebook verstößt mit Voreinstellungen zur Privatsphäre und einem Teil seiner Geschäftsbedingungen gegen Verbraucher- und Datenschutzrecht.

Künstliche Intelligenz hilft bei der Suche nach Kinderpornographie.

Und was tun gegen Pädophile, die sich auf Plattformen für Kinder und in Games für Kinder rumtreiben? Auch hier sind die notwendigen Maßnahmen mehrdimensional.

Die Anhörung zur Datenstrategie der Bundesregierung kann man sich hier ansehen.

Ermittler:innen sehen Kommunikationsdaten gerne als “objektive Beweise” wie z.B. DNA-Spuren. Das sind sie aber nicht. Der dänische Vorratsdaten-Skandal zeigt nochmal die Problematik der Vorratsdaten in ihrer gesamten Bandbreite. Und wie skandalös es ist, dass er nicht richtig aufgearbeitet wird.

The BlueDot algorithm scours news reports and airline ticketing data to predict the spread of diseases like those linked to the flu outbreak in China.

WHAT I LIKED

SHARE IT!

Ich freue mich, wenn Du diesen Newsletter weiterleitest oder ihn auf Deinen Social-Media-Kanälen teilst! Ebenso freue ich mich, wenn Du mich und meine Arbeit mit monatlich 3,50, 5 oder 10 Euro über Steady unterstützen magst.